随着全球智算集群规模跨入“万卡时代”并向“十万卡”巅峰演进,传统单机八卡服务器在应对超万亿参数模型时,因集群通信开销过大导致算力线性增长受阻,技术重心正加速向具备强互联能力的超节点架构转移。

近日,依托OISA协同创新平台,摩尔线程、中国移动研究院、之江实验室等产业伙伴正式发布《OISA高密超节点参考设计技术规范》。该规范针对当前智算中心面临的互联瓶颈、供电压力及散热极限,提出了全栈式解决方案,为构建自主可控、高性能的智算集群奠定了关键技术基石。

深度重构互联架构,实现算力密度的跨越式升级

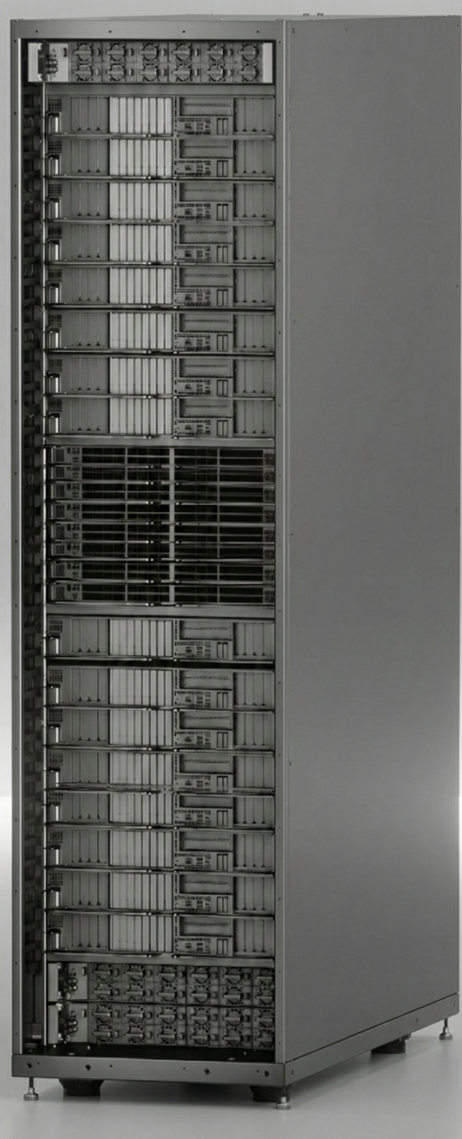

在智算中心的物理布局与逻辑拓扑中,OISA高密超节点通过空间密度与扩展维度的深度重构,打破传统架构的算力增长壁垒。技术规范大胆引入大尺寸高密线缆方案,在主流32卡至64卡互联的基础上,实现了标准单宽机柜内128卡的全互联,并支持通过并柜扩展实现256卡部署,极大优化了单位土地面积的算力产出。核心协议层面,基于OISA 2.0版本的原生内存语义支持,该设计实现了跨节点的无障碍数据访问,配合创新报文重构技术,将卡间带宽推向TB/s级别,时延缩短至数百纳秒。这种“高密度物理空间+高带宽逻辑互联”的双重革新,不仅支撑了多厂商国产芯片的兼容互通,更为大规模模型训练提供了近似单机性能的协同计算环境。

OISA高密超节点参考设计

供电与冷却双引擎革新,锻造极简绿色的基础设施

面对单颗GPU功耗攀升至700W以上、机柜功率向350kW甚至更高量级演进的严峻挑战,OISA参考设计从柜级供电及散热管理两方面完成了底座式革命。供电侧,该方案引入高压直流系统与柜内集中供电、盲插技术,通过减少中间电力转换层级,显著降低能耗损耗,为超级AI数据中心提供了稳定的动力支撑。

散热侧,液冷技术在超节点架构中从“选项”转变为“原生标配”,针对单GPU 2kW以上的散热需求进行深度优化,将PUE值从风冷时代的1.4降至1.05~1.15。通过全量监测流量、压力、温度的智能诊断系统,这种导热效率提升数千倍的技术方案,在确保系统高负载可靠性的同时,也开辟了智算产业绿色可持续发展的必然路径。

共筑自主协同生态,引领智算产业高质量演进

OISA高密超节点参考设计的发布,是产业各方凝聚共识、深化协同创新的重要里程碑,标志着智算基础设施从零散探索迈向了体系化、标准化的合作新阶段。该规范通过整合产业链上下游资源,构建一个更加包容、普惠的算力生态,通过芯片、设备、应用等环节的深度联动,为行业提供了更多元、更具韧性的技术路径选择。

展望未来,OISA协同创新平台将继续秉持开放、合作、共赢的原则,持续融合Chiplet、光互连、内存池等前沿技术,致力于与合作伙伴共同探索计算极限。以中国移动、之江实验室等为代表的产业伙伴,将不断扩大合作朋友圈,邀请更多开发者参与定制化方案设计,在开放中寻求突破,在合作中实现增益,共同绘就高效、绿色、可持续的智算未来蓝图。